Die fortschreitende Verlagerung geschäftskritischer Workloads in Edge-Umgebungen stellt IT-Teams und Cloud-Architekt:innen vor neue Herausforderungen: Wie lässt sich KI zuverlässig, compliance-konform und performant direkt vor Ort betreiben? Die jüngste Zusammenarbeit von Microsoft und Armada adressiert genau diese Fragestellung – mit dem Ansatz, Azure Local in modulare „Galleon“-Datacenter zu integrieren.

Ein aktueller Beitrag im Microsoft-Blog stellt dazu eine Reihe spannender technischer Neuerungen vor, die für Unternehmen mit hohen Anforderungen an Datenhoheit, Latenz und Infrastruktur-Resilienz relevant sind. Die vorgestellten Ergebnisse sind das Resultat der engen Zusammenarbeit von Microsoft-Engineering, Azure-Edge-Teams und den Entwicklungsteams von Armada. Besonders die technische Konsistenz der API- und Governance-Modelle verdient Beachtung, da sie für den operativen Alltag eine deutliche Vereinfachung bedeutet.

Azure Local + Galleon: Ein technischer Blick auf den Ansatz

Im Mittelpunkt steht die Kombination aus Azure Local, einer auf das Wesentliche reduzierten Azure-Laufzeitumgebung, und den modularen, Edge-optimierten Rechenzentrumsmodulen von Armada. Diese können an nahezu jedem Ort betrieben werden – unabhängig von Strom- oder Netzwerkinfrastruktur.

Wesentliche technische Merkmale:

-

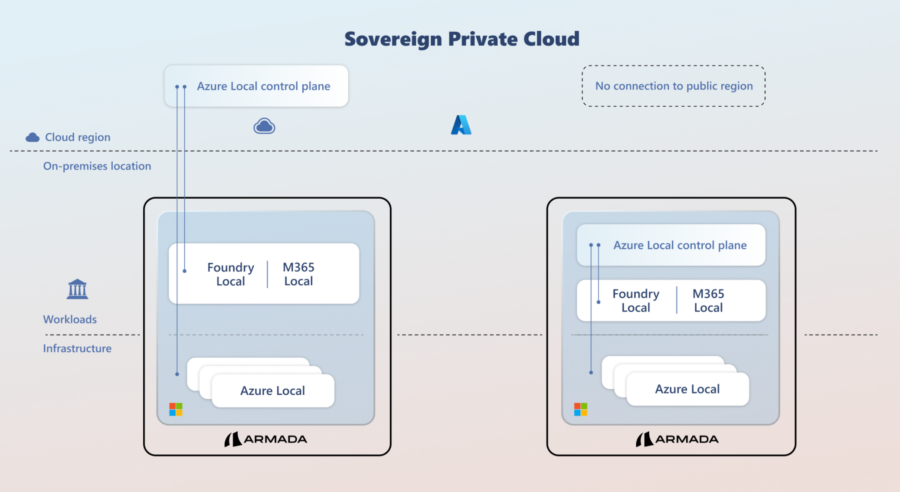

Souveränität und Datenlokalität

Workloads bleiben vollständig lokal – inklusive KI-Inferenz, Container-Workloads und Speicher. Das reduziert regulatorische Risiken und ermöglicht strikte Datenhoheit in sensiblen Branchen. -

Betrieb ohne stabile Cloud-Backbone-Verbindung

Die Galleon-Module bieten autarke Betriebsmodi, sodass Azure-Dienste auch in Umgebungen mit eingeschränkter oder intermittierender Konnektivität verfügbar bleiben. -

Standardisierte Azure-APIs am Edge

Dies erleichtert die Integration in bestehende Deployments und ermöglicht konsistente Governance-, Update- und Sicherheitsprozesse. -

Hardwareoptimierung für AI-Inferenz am Edge

Armada kombiniert GPU-beschleunigte Systeme mit optimierten Kühl- und Energiearchitekturen, um Modelle lokal und kosteneffizient auszuführen. -

Schnelle Bereitstellung durch modulare Bauweise

Die Datacenter-Module können ohne großen Bauaufwand bereitgestellt werden und sind damit prädestiniert für kritische Infrastrukturen, Produktionsstandorte oder abgelegene Regionen.

Relevanz für IT-Admins und Cloud-Architekten

Der kombinierte Ansatz eröffnet neue Optionen für:

- hybride Azure-Architekturen mit striktem Fokus auf Edge-KI,

- Konsistenz der Betriebsmodelle zwischen Cloud, On-Prem und Edge,

- resilienten Betrieb in Regionen ohne klassisches Datacenter,

- Organisationen, die regulatorisch bedingt keine Daten in die Public Cloud geben dürfen oder können.

Für Architekten ergibt sich die Möglichkeit, Azure-Workloads präzise dort laufen zu lassen, wo sie benötigt werden – inklusive KI-Modellen, die sonst auf zentrale GPUs angewiesen wären.

Fazit

Azure Local auf modularen Galleon-Datacentern adressiert eine wachsende Nachfrage: KI dort zu betreiben, wo Daten entstehen – sicher, lokal und mit Azure-typischer Verwaltungssouveränität. Für viele Branchen könnte dieser Ansatz künftig eine zentrale Rolle beim Aufbau souveräner KI- und Edge-Plattformen spielen.